La e-salud y el soporte al diagnóstico y tratamiento de pacientes de ictus son algunas de las aplicaciones del proyecto ‘Eye Tracker’, desarrollado por un equipo de investigadores de la Universidad Europea Miguel de Cervantes (UEMC) de Valladolid. Se trata de una tecnología que determina a partir de un stream de vídeo la dirección de la mirada de un usuario, integrando dicha tecnología en un videojuego de realidad virtual como parte de la interacción del usuario con el sistema.

La UEMC, a través de su Grupo de Investigación en Discapacidad Física y Sensorial (GIDFYS) en la que participa ASPAYM, y con la colaboración de la empresa especializada en videojuegos de Valladolid Rapture Games, han trabajado conjuntamente para el desarrollo de una herramienta de ayuda al diagnóstico y la rehabilitación de pacientes con pérdida parcial del campo visual. Estos pacientes son identificados por los especialistas del Hospital Clínico Universitario de Valladolid, que se encarga de realizar una primera atención y diagnóstico.

Dado que se encuentran dificultades a la hora de cuantificar el grado de mejora de los mencionados pacientes, así como facilitar la rehabilitación de los mismos, se ha propuesto la creación de un entorno de realidad virtual en el cual, el paciente, a través de los videojuegos, pueda entrenar las regiones del campo visual afectadas por el ictus. Al mismo tiempo, la aplicación podrá ir almacenando los datos obtenidos para dar información relevante a los especialistas que guíen las sesiones.

Desarrollo del prototipo

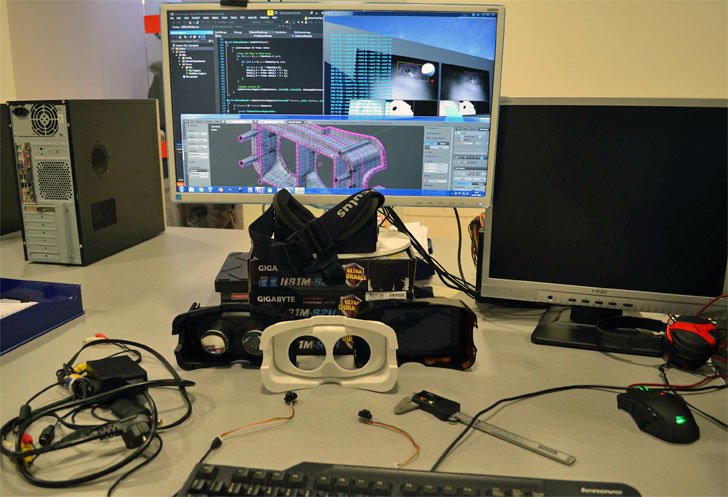

Para lograr estos objetivos se utilizó un modelo de gafas de realidad virtual denominado Oculus Rift. Actualmente, el modelo comercial no ofrece la posibilidad de realizar grabación de los ojos dentro del dispositivo, por lo que ha sido necesario realizar un prototipo sobre el que mecanizar las modificaciones físicas necesarias.

Para ello, se desmontó el dispositivo de realidad virtual y se estudiaron las partes que debían ser modificadas para la incorporación de las micro-cámaras. A continuación, se realizó un escaneo de la pieza detectada mediante un láser de brazo, para la toma de medidas con una precisión de décimas de milímetro. Posteriormente, se generó un modelo simplificado a partir de dicho escaneo y se realizó una impresión 3D de la pieza.

Al mismo tiempo, fue necesario realizar varios módulos software encargados de estimar la posición de la pupila dentro del ojo para determinar la dirección de la mirada (Eye tracker) empleando visión computacional y análisis de imagen dentro de un vídeo en tiempo real. Otro módulo cuyo objetivo era crear un pequeño entorno controlado en 3D dentro del motor de videojuegos Unreal Engine. Asimismo, fue necesario desarrollar un paquete software para realizar la integración del Eye tracker dentro del videojuego.

Por último, se implementó un módulo de autocalibración que emplea la información que se va recogiendo del ojo para refinar la dirección hacia donde está mirando el usuario mientras se van capturando datos. Este último software se encarga de mover una esfera, en el espacio inmediatamente frente al personaje virtual, que ilustra la dirección de la mirada del usuario dentro de su campo de visión.

El conjunto del dispositivo físico y el desarrollo software, tiene previsto realizar un estudio en pacientes reales para comprobar el grado de aceptación, facilidad de uso, precisión y mejora de las personas sensibles a ser tratadas con esta tecnología. Al mismo tiempo, se ha buscado que la implantación y difusión sea la máxima posible detectando las alternativas más económicas dentro de la gama de dispositivos disponible. De esta forma, se consigue un sistema low-cost que pueda ser adquirido por el mayor número de consultas e incluso usuarios finales que lo deseen.